Un análisis de los tuits de las elecciones presidenciales de 2016 en EE UU concluye que las cuentas automáticas tuvieron un papel crucial en la difusión de noticias falsas. Tan solo un 6% de los bots fueron responsables de propagar el 31% de la información de baja credibilidad en la red.

Los bots tuvieron un papel muy relevante como difusores de información falsa en las últimas elecciones presidenciales de EE UU, cuyo vencedor fue Donald Trump. Así lo afirma un estudio, realizado por investigadores de la Universidad de Indiana (IU) y publicado hoy en la revista Nature Communications.

Otro trabajo de investigadores del MIT, que apareció en Science a comienzos de año, analizó también este fenómeno y llegó a la conclusión de que las noticias falsas se extienden en Twitter porque los humanos, no los bots, las propagamos más deprisa que la verdad. En su análisis, las falsedades tenían un 70% más probabilidades de ser retuiteadas por los usuarios que la información veraz.

El estudio actual no contradice aquel de Science. Lo que pone de relieve es el papel desproporcionado que tienen los bots en la difusión de noticias falsas, ya que tan solo un 6% de las cuentas de Twitter identificadas como bots en el trabajo fueron suficientes para difundir el 31% de la información de baja credibilidad en la red. También fueron responsables del 34% de todos los artículos compartidos procedentes de fuentes de poca veracidad.

El nuevo análisis de la Universidad de Indiana confirma que los humanos hacen la mayor parte de los retuits, tanto de noticias publicadas por bots como por personas reales.

"En realidad, el estudio del MIT no decía que los bots no sean responsables de la difusión de noticias falsas, sino que ellos por sí solos no explican el aumento en la viralidad. Nosotros encontramos que los humanos comparten mucha desinformación, y a menudo retuitean la procedente de los bots", explica a Sinc Filippo Menczer, profesor de Computación e Ingeniería en la IU y director del estudio.

La investigación analizó 14 millones de tuits y 400.000 artículos compartidos en Twitter entre mayo de 2016 y marzo de 2017, un periodo que abarca desde el final de las primarias presidenciales de 2016 hasta la toma de posesión del cargo por parte de Trump el 20 de enero de 2017.

Estas cuentas automáticas fueron fundamentales en los primeros momentos antes de que las historias se volvieran virales, un intervalo de tiempo muy breve que dura de 2 a 10 segundos. "Hemos demostrado que los bots contribuyen a la difusión de la desinformación on line y que estos mensajes se extienden con rapidez", señala Menczer.

"El anterior artículo del MIT no contemplaba el caso común en el que un bot retuitea a un humano y luego muchas personas vuelve a retuitearlo. Su análisis asumió que en ese caso el bot no tenía ningún papel. Además, nosotros analizamos un conjunto mucho mayor de artículos de baja credibilidad", aclara a Sinc Menczer.

La conclusión que se extrae de ambos análisis, según Menczer, es que la desinformación se propaga por múltiples razones, como la novedad de los mensajes, la amplificación por parte de los bots, así como los sesgos cognitivos y sociales de las personas.

En el nuevo estudio de la Universidad de Indiana, las fuentes de información poco creíbles se identificaron por su aparición en listas elaboradas por organizaciones independientes. Estas fuentes –que suelen usar nombres engañosos como ‘USAToday.com.co’– incluyen puntos de vista tanto de derecha como de izquierda.

Otro de los autores, Giovanni Luca Ciampaglia, señala que "tendemos a confiar más en los mensajes que parecen proceder de muchas personas. Los bots se aprovechan de esto haciendo que los mensajes parezcan muy populares y así engañan a la gente para que difunda sus mensajes".

Los investigadores identificaron otras tácticas para difundir información falsa con los bots de Twitter. Estas incluían la amplificación de un solo tuit –que podría estar controlado por un operador humano– a través de cientos de retuits automatizados; la repetición de enlaces en mensajes recurrentes; y la selección de cuentas influyentes.

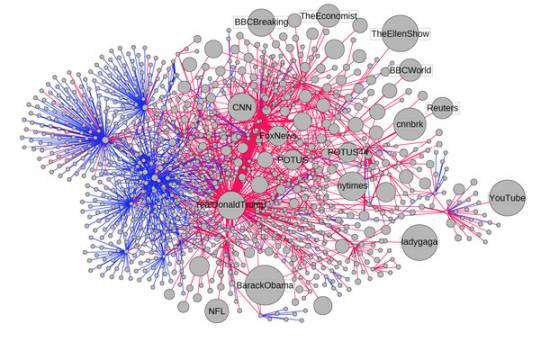

Por ejemplo, el estudio cita un caso en el que una sola cuenta mencionó a @realDonaldTrump en 19 mensajes acerca de tres millones de inmigrantes ilegales que habían votado en las elecciones presidenciales. La afirmación era falsa, pero el Gobierno estadounidense la utilizó para reforzar sus intereses.

La imagen muestra la difusión de un artículo que afirmaba que tres millones de inmigrantes ilegales votaron en las elecciones presidenciales de 2016 en EE UU. Los enlaces muestran la difusión del artículo a través de los retuits y tuits citados (en azul) y las respuestas y menciones (en rojo). / Filippo Menczer / IU

Para averiguar qué sucedería si los bots desaparecieran, los investigadores llevaron a cabo un experimento en una versión simulada de Twitter. Encontraron que tras eliminar el 10% de las cuentas con alta probabilidad de ser bots el número de historias de fuentes de baja credibilidad en la red se desplomaba.

"Este experimento indica que la eliminación de los bots de las redes sociales reduciría significativamente la cantidad de desinformación en estas redes", subraya Menczer.

El estudio propone medidas que Twitter podría tomar para frenar la difusión de información errónea. Estas incluyen la mejora de los algoritmos para detectar automáticamente a los bots e incluir modelos que requieran interacción humana. Por ejemplo, a los usuarios se les podría pedir completar un CAPTCHA para enviar un mensaje.

Aunque el análisis se ha centrado en Twitter, los autores señalan que otras redes sociales son también vulnerables a la manipulación. Por ejemplo, Snapchat y WhatsApp tienen dificultades para controlar la información falsa porque el uso de cifrado y los mensajes destructibles complica la capacidad de estudiar cómo comparten la información sus usuarios.

"A medida que la gente de todo el mundo recurre cada vez más a las redes sociales como su principal fuente de noticias e información, la lucha contra la desinformación requiere una evaluación del impacto de las diferentes formas en que se propaga", comenta Menczer. "Este trabajo confirma que los bots influyen en el problema y pone de manifiesto que su reducción podría mejorar la situación", insiste.

Para explorar los mensajes electorales que actualmente se comparten en Twitter, el grupo de investigación ha lanzado la herramienta de medición Bot Electioneering Volume. Creada por estudiantes de doctorado de la universidad estadounidense, esta aplicación muestra el nivel de actividad de los bots en conversaciones específicas relacionadas con las elecciones, así como los temas, nombres de usuario y hashtags con los que se presiona.

Referencia bibliográfica:

Filippo Menczer, Giovanni Luca Ciampaglia. “The spread of low-credibility content by social bots”. Nature Communications (20 de noviembre, 2018) DOI: 10.1038/s41467-018-06930-7

Para saber más mira el vídeo del coloquio SINC sobre fake news y tecnologías que mantuvimos con Clara Jiménez Cruz, periodista de maldita.es, y Helena Matute, psicóloga de la Universidad de Deusto.